- l'AGI ARRIVE, Préparez-vous

- Posts

- Anthropic démasque une campagne d'espionnage IA massive menée par des concurrents étrangers

Anthropic démasque une campagne d'espionnage IA massive menée par des concurrents étrangers

AUSSI : OpenAI prépare secrètement des appareils physiques intelligents, le fabricant de puces IA Cerebras dépose discrètement son dossier d'entrée en bourse, et bien plus.

Aujourd'hui:

Anthropic démasque une campagne d'espionnage IA massive menée par des concurrents étrangers

Le Pentagone enrôle Grok d'Elon Musk dans une offensive IA militaire majeure

Le ministre de la Défense s'oppose au PDG d'Anthropic sur les restrictions militaires de l'IA

OpenAI prépare secrètement des appareils physiques intelligents

Le fabricant de puces IA Cerebras dépose discrètement son dossier d'entrée en bourse

Want to get the most out of ChatGPT?

ChatGPT is a superpower if you know how to use it correctly.

Discover how HubSpot's guide to AI can elevate both your productivity and creativity to get more things done.

Learn to automate tasks, enhance decision-making, and foster innovation with the power of AI.

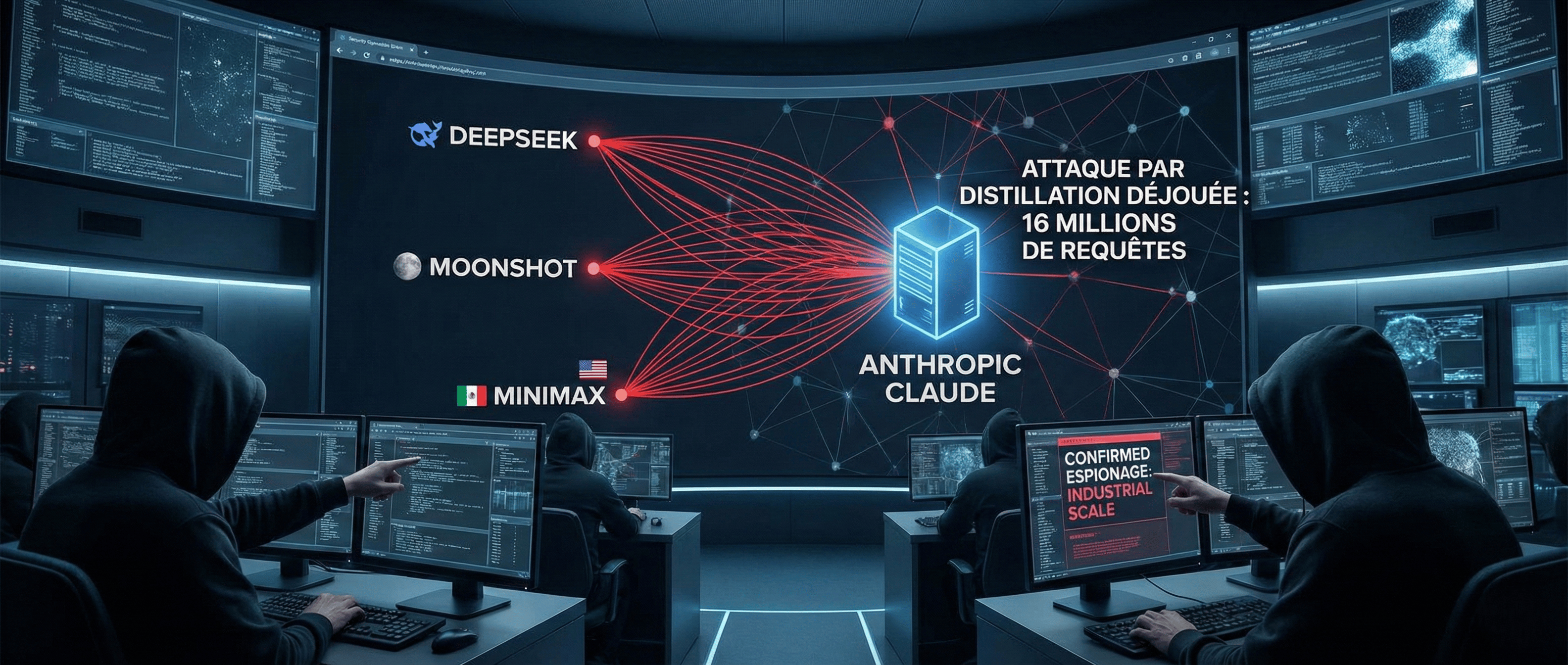

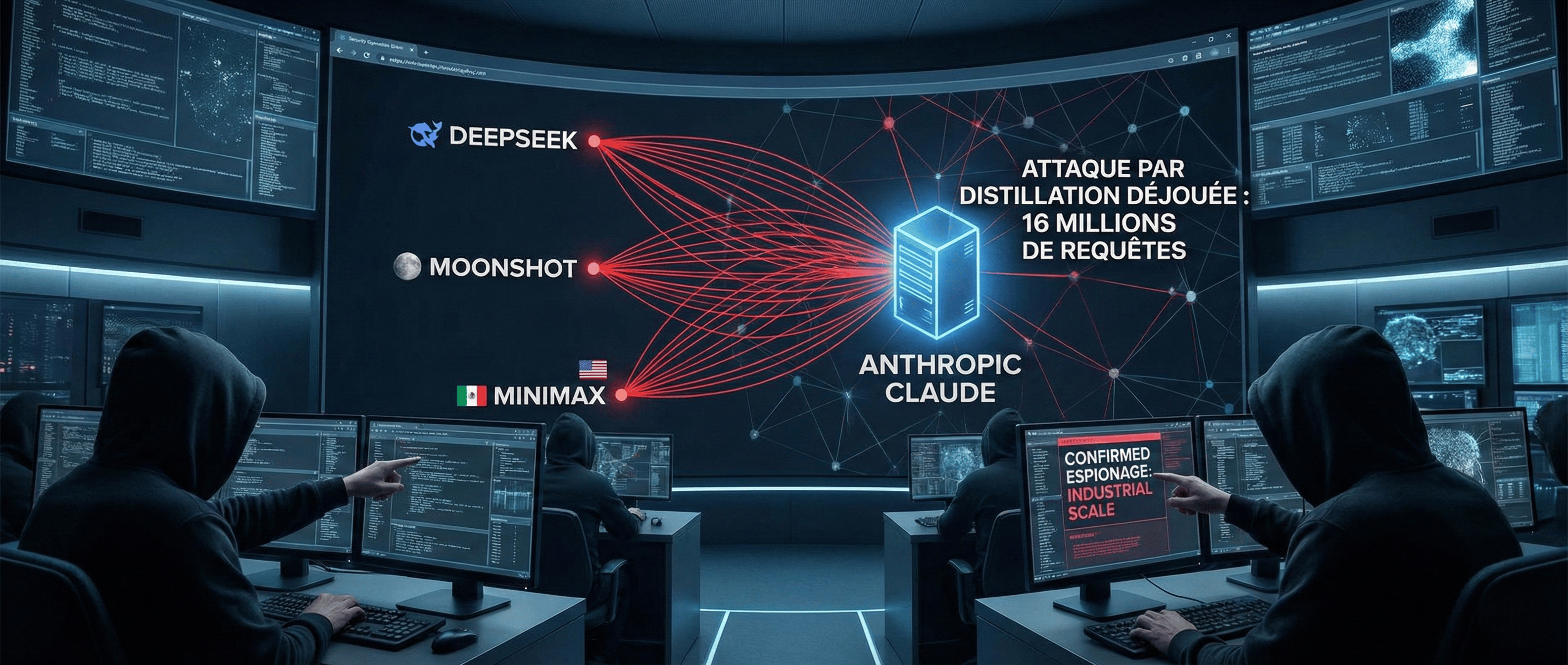

Pendant qu'Anthropic se bat avec le Pentagone sur un front, l'entreprise repousse des espions internationaux sur un autre. Elle vient de publier un rapport explosif révélant qu'elle a déjoué des campagnes d'espionnage « à échelle industrielle » menées par trois grands labos IA étrangers : DeepSeek, Moonshot et MiniMax.

Qu'est-ce qui s'est passé ? Ces labos ont utilisé une technique appelée « attaque par distillation ». Ils ont créé environ 24 000 comptes frauduleux via des serveurs proxy et ont injecté plus de 16 millions de requêtes ultra-spécifiques dans Claude. Leur objectif ? Extraire secrètement les capacités avancées de raisonnement et de code de Claude pour entraîner leurs propres modèles moins chers, en une fraction du temps qu'il faudrait pour les construire de zéro.

Anthropic les a repérés en identifiant des schémas de trafic hautement synchronisés et en remontant les métadonnées directement jusqu'à des chercheurs seniors de ces labos. Mais ce n'est pas qu'une histoire de vol d'entreprise — c'est un risque de sécurité majeur. Quand ces labos étrangers « distillent » un modèle américain, ils suppriment tous les garde-fous de sécurité au passage. Les modèles clonés qui en résultent peuvent alors être utilisés par des gouvernements autoritaires pour des cyberopérations, la recherche sur les armes biologiques et la désinformation — sans aucun contrôle.

Si vous pensiez que les réunions tech se résumaient à des feuilles de route et du « synergy », détrompez-vous. Le secrétaire américain à la Défense Pete Hegseth a convoqué le PDG d'Anthropic, Dario Amodei, au Pentagone pour ce qu'un haut responsable de la défense a crûment qualifié de réunion « c'est maintenant ou jamais ».

Voici la situation : le Claude d'Anthropic est actuellement le seul modèle IA autorisé à fonctionner au sein des réseaux classifiés de l'armée américaine. Claude aurait même été utilisé pour aider à planifier le raid de janvier qui a conduit à la capture du président vénézuélien Nicolás Maduro. Mais Anthropic tient une ligne éthique très ferme : l'entreprise refuse que l'armée utilise Claude pour de la surveillance de masse des citoyens américains ou pour des armes totalement autonomes (des armes qui tirent sans intervention humaine).

Le Pentagone est furieux. Il veut que les labos d'IA autorisent l'utilisation de leurs modèles pour « toutes les fins légales », sans poser de questions. Le conflit est devenu si virulent que le ministère de la Défense menace de classer Anthropic comme « risque pour la chaîne d'approvisionnement » — une désignation dévastatrice habituellement réservée aux adversaires étrangers, qui forcerait quiconque fait affaire avec l'armée à couper les ponts avec l'entreprise. C'est un choc culturel colossal entre l'éthique de sécurité IA de la Silicon Valley et l'obsession militaire pour la domination technologique rapide.

Donc, si le Pentagone menace de virer Anthropic à cause de ses règles de sécurité trop strictes, qui prend le relais ? Grok. Oui, l'IA sans filtre d'Elon Musk rejoint l'armée.

Le secrétaire à la Défense Hegseth a annoncé une nouvelle « stratégie d'accélération IA », révélant que le Pentagone va commencer à intégrer Grok de xAI dans les réseaux militaires américains — classifiés et non classifiés — dès ce mois-ci.

Contrairement à Anthropic, des entreprises comme xAI (ainsi qu'OpenAI et Google) auraient accepté de laisser le ministère de la Défense utiliser leurs systèmes sans les mêmes restrictions éthiques, offrant à l'armée le « carte blanche » qu'elle exige. C'est un pivot fascinant et massif pour la tech militaire. Pendant qu'Anthropic trace des lignes rouges sur les droits humains et les armes autonomes, le Pentagone avance agressivement pour intégrer Grok dans ses rangs.

🧠 RECHERCHE

Quand on entraîne une IA par essai-erreur, le processus d'apprentissage plante souvent si le système se désynchronise avec les données qu'il génère. VESPO est une nouvelle méthode mathématique qui corrige ce déséquilibre en douceur, gardant l'entraînement stable et améliorant les performances sur différents types de modèles IA.

Les modèles IA modernes ont tendance à trop réfléchir, produisant des réponses interminables qui gaspillent de la puissance de calcul et nuisent à la précision. Des chercheurs ont découvert que ces modèles savent en réalité quand ils ont trouvé la bonne réponse, mais leur architecture actuelle ne leur permet pas de s'arrêter. Une nouvelle méthode leur apprend à stopper plus tôt, améliorant à la fois la vitesse et la précision.

Les IA génératrices d'images peinent souvent à reproduire des transformations visuelles complexes à partir d'exemples. LoRWeB résout ce problème en combinant à la volée plusieurs petits outils d'édition spécialisés. Résultat : l'IA comprend mieux les analogies visuelles et applique avec précision de nouveaux styles ou modifications à des images totalement différentes.

📲 RÉSEAUX SOCIAUX

🗞️PLUS D'ACTUALITÉS

Les appareils IA d'OpenAI OpenAI a constitué une équipe de 200 personnes pour construire des produits physiques — enceintes connectées, lunettes intelligentes et lampes — propulsés par son intelligence artificielle. L'entreprise prévoit de vendre sa première enceinte connectée entre 200 et 300 $, pour amener ses assistants numériques directement dans le monde physique. Ce virage vers le matériel montre que le géant du logiciel veut contrôler précisément la façon dont les gens interagissent avec sa technologie au quotidien.

Cerebras dépose son dossier d'entrée en bourse Cerebras, le fabricant de puces IA, a discrètement déposé ses documents pour devenir une entreprise cotée en bourse aux États-Unis. Cette démarche intervient après un important contrat commercial avec OpenAI, signe que les entreprises tech sont avides d'alternatives au fabricant dominant Nvidia. En vendant des actions au public, Cerebras espère lever les fonds nécessaires pour rivaliser sur le marché en pleine explosion des puces qui font tourner les programmes IA modernes.

DeepSeek prépare un nouveau modèle IA La startup chinoise DeepSeek s'apprête à lancer un nouveau système d'intelligence artificielle très avancé. Les experts financiers redoutent que cette sortie provoque une chute brutale des cours des grandes entreprises tech américaines cotées au Nasdaq. Les investisseurs craignent que la capacité de DeepSeek à créer des logiciels puissants et bon marché ne menace les profits colossaux et la domination des géants technologiques américains.

Les « Frontier Alliances » d'OpenAI OpenAI a lancé un nouveau programme baptisé « Frontier Alliances » en s'associant avec les plus grands cabinets de conseil mondiaux — McKinsey, Boston Consulting Group, Accenture et Capgemini. Ces experts du conseil aideront les grandes entreprises à comprendre comment utiliser concrètement la nouvelle plateforme d'OpenAI pour automatiser leurs tâches quotidiennes et organiser leurs données. En s'appuyant sur des consultants établis, OpenAI veut prouver que sa technologie peut résoudre de vrais problèmes d'entreprise — et pas seulement servir de gadget.