- l'AGI ARRIVE, Préparez-vous

- Posts

- Grok Code Fast 1 dévoilé : vitesse fulgurante, coût réduit et utilisation gratuite

Grok Code Fast 1 dévoilé : vitesse fulgurante, coût réduit et utilisation gratuite

OpenAI lance gpt-realtime, Anthropic va utiliser les conversations pour la formation et plus encore.

Aujourd'hui:

Grok Code Fast 1 dévoilé : vitesse fulgurante, coût réduit et utilisation gratuite

Microsoft AI dévoile les modèles MAI-Voice-1 et MAI-1-Preview

OpenAI lance gpt-realtime : une IA vocale rapide et plus intelligente pour la production

Anthropic utilise les conversations pour la formation : voici votre choix

Ne restez pas à la traîne. Maîtrisez les dernières innovations en IA et propulsez votre carrière vers de nouveaux sommets. Inscrivez-vous maintenant et devenez un leader en IA. 49,00 € |

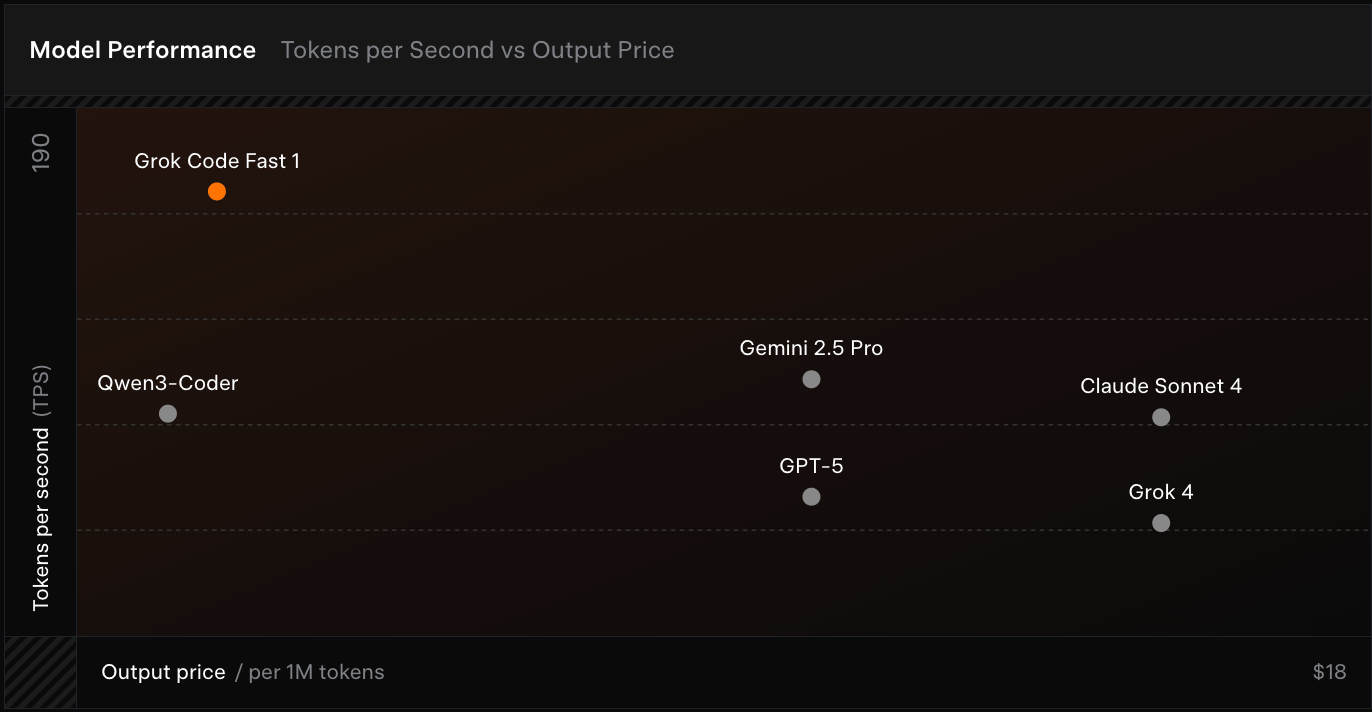

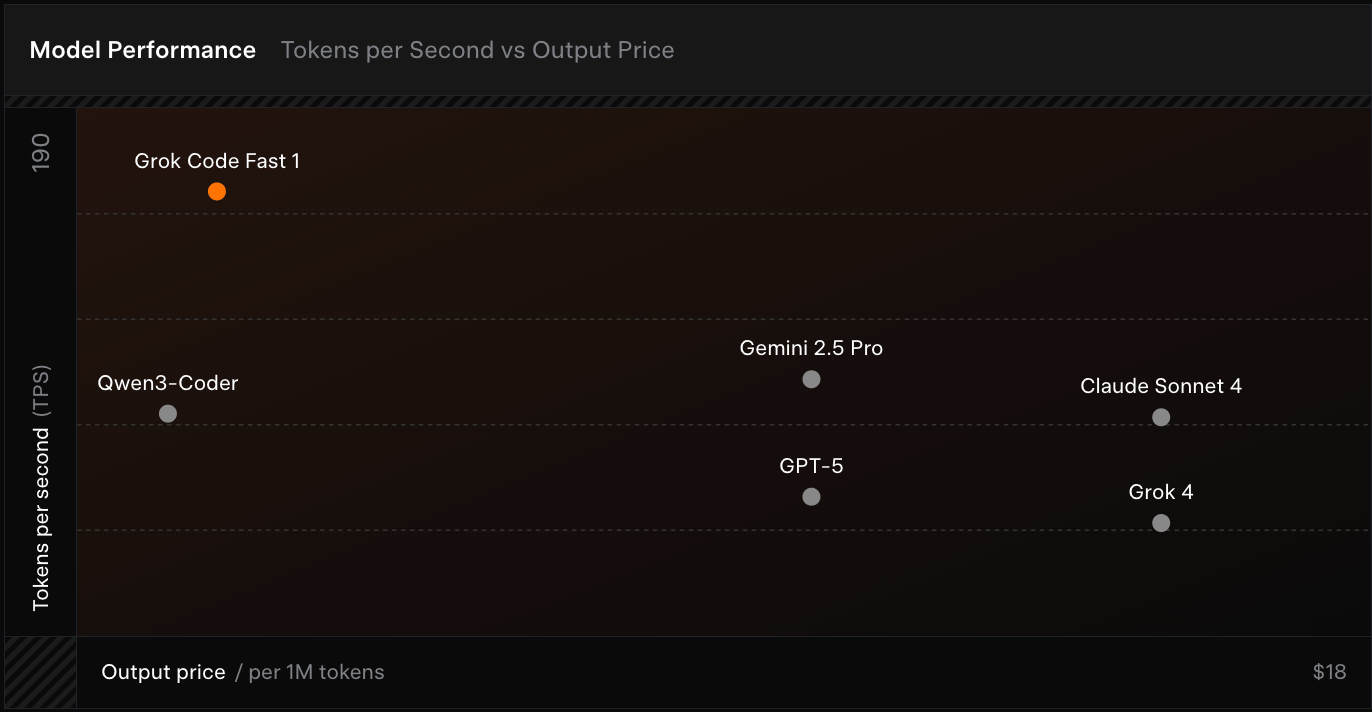

Grok Code Fast 1 est un modèle d'IA ultra-rapide et économique, conçu pour le codage quotidien. Optimisé pour les tâches de codage agentiques , il offre une utilisation quasi instantanée des outils, une mise en cache rapide et une prise en charge multilingue performante. Conçu de A à Z à partir de données de codage réelles, il surpasse ses concurrents en termes de vitesse et de prix. Désormais gratuit sur GitHub Copilot, Cursor et d'autres plateformes, il est idéal pour les développeurs ayant besoin d'une assistance rapide, fiable et abordable.

Pourquoi c'est important

Percée du codage agentique

Il cible directement les flux de travail agentiques, où les modèles d'IA parcourent les étapes de raisonnement et les outils de manière autonome, rendant le codage quotidien plus fluide et plus productif.Vitesse + Efficacité des coûts

Grok Code Fast 1 atteint une vitesse et un rapport qualité-prix inégalés, perturbant l'économie du LLM et démocratisant l'accès à des assistants de code compétents.Orientation développeur du monde réel

En s'entraînant sur des demandes d'extraction réelles et en priorisant les évaluations pratiques, le modèle comble le fossé entre les benchmarks et l'utilisation pratique du développement logiciel.

Microsoft AI a dévoilé deux nouveaux modèles internes : MAI-Voice-1 , un générateur de voix rapide et expressif, désormais disponible dans Copilot Labs et Podcasts, et MAI-1-preview , un modèle de suivi d'instructions de grande taille, entraîné sur 15 000 GPU H100, actuellement en test sur LMArena. Ces lancements illustrent la volonté de Microsoft de développer une IA dédiée et centrée sur l'humain, de la parole naturelle aux assistants intelligents, tout en annonçant une évolution plus large vers un avenir multi-modèles au sein de Copilot.

Pourquoi c'est important

Microsoft entre dans la course à l'IA vocale

MAI-Voice-1 défie ElevenLabs et le moteur vocal d'OpenAI avec un son ultra-rapide, expressif et en temps réel, essentiel pour les compagnons d'IA de nouvelle génération.Le modèle MoE à 15 000 GPU signale une poussée d'échelle.

L'aperçu de MAI-1 prouve que Microsoft construit des modèles de base sérieux en interne, et ne s'appuie pas uniquement sur OpenAI, ce qui indique des ambitions AGI internes.Direction de l'IA centrée sur l'humain et multimodale

Microsoft aligne ses modèles sur l'expression émotionnelle, l'intention de l'utilisateur et la narration, laissant entrevoir un avenir où l'IA n'est pas seulement intelligente, mais personnelle.

OpenAI a lancé gpt-realtime , son modèle vocal le plus avancé, désormais disponible dans l'API Realtime entièrement déployée. Il offre une parole rapide et naturelle et un raisonnement précis aux agents vocaux, avec des améliorations telles que la saisie d'images, la prise en charge des téléphones SIP et l'intégration MCP à distance. gpt-realtime surpasse également les modèles précédents en termes de suivi d'instructions et d'appel de fonctions. Avec deux nouvelles voix et une réduction de prix de 20 %, il est désormais prêt pour un déploiement à grande échelle sur les systèmes de production.

Pourquoi c'est important

Les agents vocaux atteignent une maturité prête pour la production

gpt-realtime permet une IA de bout en bout à faible latence, essentielle pour le support client, la formation et le déploiement d'assistants en temps réel.Avancée multimodale + appel d'outils

Le modèle gère la saisie d'images, l'utilisation d'outils asynchrones et les appels téléphoniques, repoussant ainsi les limites de ce que les agents vocaux peuvent interpréter et faire.L'IA devient une infrastructure conversationnelle

Avec des outils d'entreprise tels que la prise en charge SIP et MCP, OpenAI positionne gpt-realtime comme une couche backend pour les opérations commerciales basées sur le langage naturel à grande échelle.

🧠 RECHERCHE

Des chercheurs ont appliqué des outils d'interprétabilité aux modèles de reconnaissance vocale et ont découvert comment le son et le sens évoluent d'une couche à l'autre. Ils ont également identifié les causes cachées des répétitions de mots et des erreurs de sens. Ces résultats contribuent à améliorer la précision et l'explicabilité des modèles, rendant les systèmes d'IA vocale plus fiables et plus compréhensibles.

Vision-SR1 est un nouveau modèle d'IA qui améliore la compréhension des images et du texte par les machines. Il utilise l'apprentissage par renforcement auto-récompensé pour décomposer les tâches en deux étapes : la vision et le raisonnement. Cette méthode améliore la précision, réduit les fausses descriptions et évite de trop s'appuyer sur le langage, le tout sans recourir à des étiquettes humaines coûteuses ni à des modèles externes.

Le framework MIDAS crée des humains numériques réalistes qui réagissent en temps réel par la voix, le mouvement et le texte. Il combine un modèle linguistique simplifié avec un outil de compression vidéo pour réduire les délais et optimiser les performances. MIDAS prend en charge la génération vidéo rapide, contrôlable et multilingue, permettant des conversations fluides et interactives entre humains numériques et humains pour diverses tâches.

📲 RÉSEAUX SOCIAUX

Voici à quoi ressemblait Paris autrefois 🗼

L’heure du déjeuner à Paris dans les années 1920. restauré grâce à l'IA.

— VISION IA (@vision_ia)

8:39 AM • Aug 29, 2025

Incroyable démo d’influenceur IA... Depuis l’apparition de Nano-Banana, tout va tellement vite qu’il est parfois difficile de suivre la cadence.

C’est désormais Higgsfield qui l’implémente.

— VISION IA (@vision_ia)

8:00 AM • Aug 29, 2025

QUOI ? Très très étrange !

Il semble qu’OpenAI ait réalisé une avancée majeure sur la voie de l’AGI.

Hier, plusieurs employés ont publié des tweets mysterieux évoquant une possible percée. Ils n'y vont pas de main morte en plus.

Sachant ce qu'il s'est passé avec GPT-5, ce

— VISION IA (@vision_ia)

7:00 AM • Aug 29, 2025

🗞️PLUS D'ACTUALITÉS

Un nouveau rançongiciel basé sur l'IA, PromptLock, utilise le modèle gpt-oss:20b d'OpenAI pour créer des scripts malveillants qui chiffrent ou volent des fichiers sur plusieurs plateformes. Il complexifie la détection et marque une évolution de la cybercriminalité grâce à l'IA générative.

Google a lancé une version basique de Vids, son éditeur vidéo basé sur l'IA, accessible à tous les utilisateurs. Si l'accès gratuit inclut des modèles et des banques d'images, les outils avancés comme les avatars IA et la conversion d'images en vidéos restent exclusifs aux forfaits payants.

Cambricon , fabricant chinois de puces d'IA, a enregistré des bénéfices records, la Chine accélérant ses efforts pour remplacer Nvidia. Cette hausse reflète la volonté de Pékin d'obtenir une indépendance technologique nationale dans un contexte de tensions géopolitiques croissantes et de contrôles américains à l'exportation visant les puces d'IA avancées.

Google investit 9 milliards de dollars en Virginie pour développer son infrastructure cloud et d'IA et former la main-d'œuvre locale. Cet investissement comprend un nouveau centre de données, des partenariats d'innovation énergétique et une formation gratuite à l'IA pour les étudiants des universités de Virginie. Il s'inscrit dans le cadre d'un effort plus large de Google visant à renforcer le leadership américain en matière d'IA et les opportunités économiques grâce à l'infrastructure technologique et à l'éducation.

Des scientifiques singapouriens ont créé un nouveau modèle d'IA inspiré du cerveau, appelé HRM, qui surpasse des modèles de pointe comme ChatGPT aux tests de raisonnement. Contrairement aux modèles de langage traditionnels, HRM imite le fonctionnement du cerveau humain, en utilisant moins de paramètres et de données d'entraînement. Il a obtenu d'excellents résultats au test de performance ARC-AGI, un test prometteur pour l'IA du futur, capable de penser plus efficacement et de résoudre des problèmes complexes avec moins de ressources.