- l'AGI ARRIVE, Préparez-vous

- Posts

- Sortie de GLM-5 : un rival chinois sérieux pour Claude Opus 4.6

Sortie de GLM-5 : un rival chinois sérieux pour Claude Opus 4.6

AUSSI : Mistral investit 1,2 milliard $ dans un data center en Suède, OpenAI dissout discrètement son équipe d'alignement, et bien plus.

Aujourd'hui:

Sortie de GLM-5 : un rival chinois sérieux pour Claude Opus 4.6

Musk réorganise xAI dans une course à la vitesse

ByteDance négocie ses propres puces avec Samsung

Mistral investit 1,2 milliard $ dans un data center en Suède

OpenAI dissout discrètement son équipe d'alignement

Dictate prompts and tag files automatically

Stop typing reproductions and start vibing code. Wispr Flow captures your spoken debugging flow and turns it into structured bug reports, acceptance tests, and PR descriptions. Say a file name or variable out loud and Flow preserves it exactly, tags the correct file, and keeps inline code readable. Use voice to create Cursor and Warp prompts, call out a variable like user_id, and get copy you can paste straight into an issue or PR. The result is faster triage and fewer context gaps between engineers and QA. Learn how developers use voice-first workflows in our Vibe Coding article at wisprflow.ai. Try Wispr Flow for engineers.

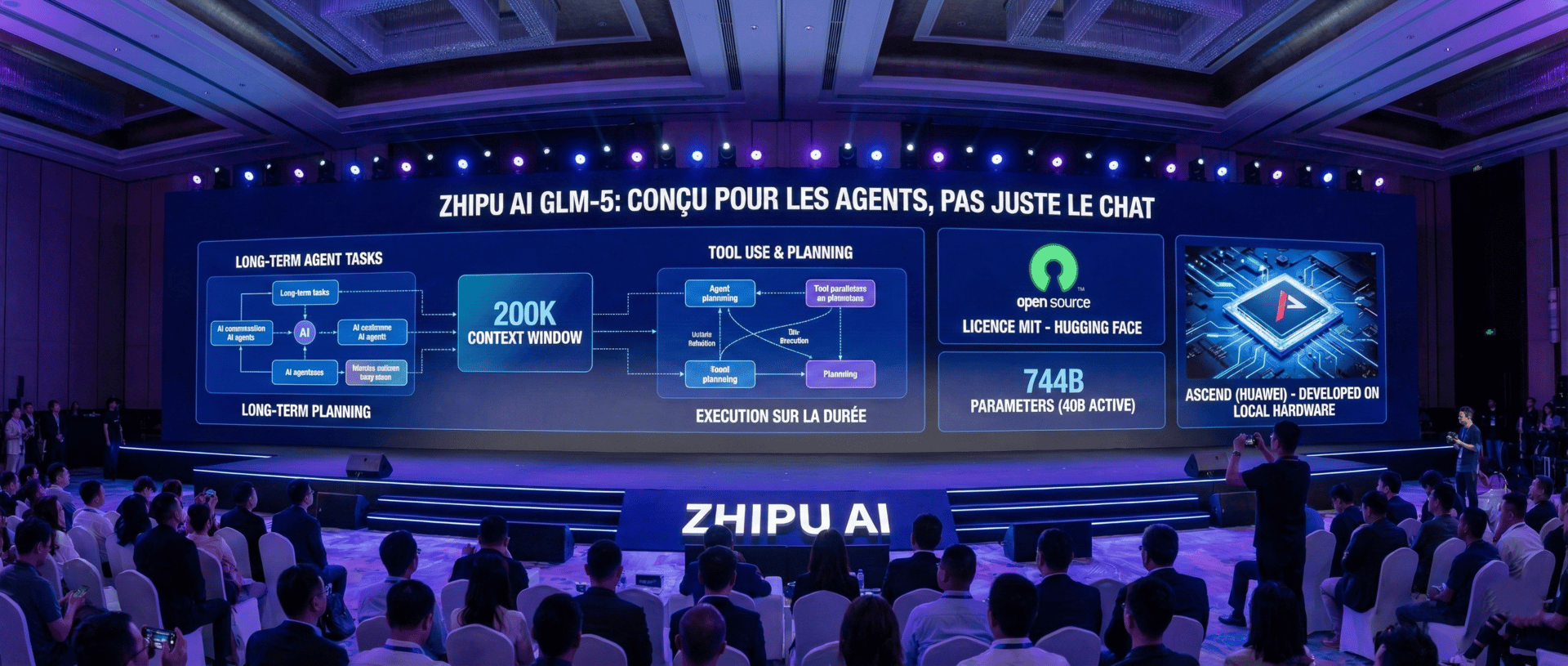

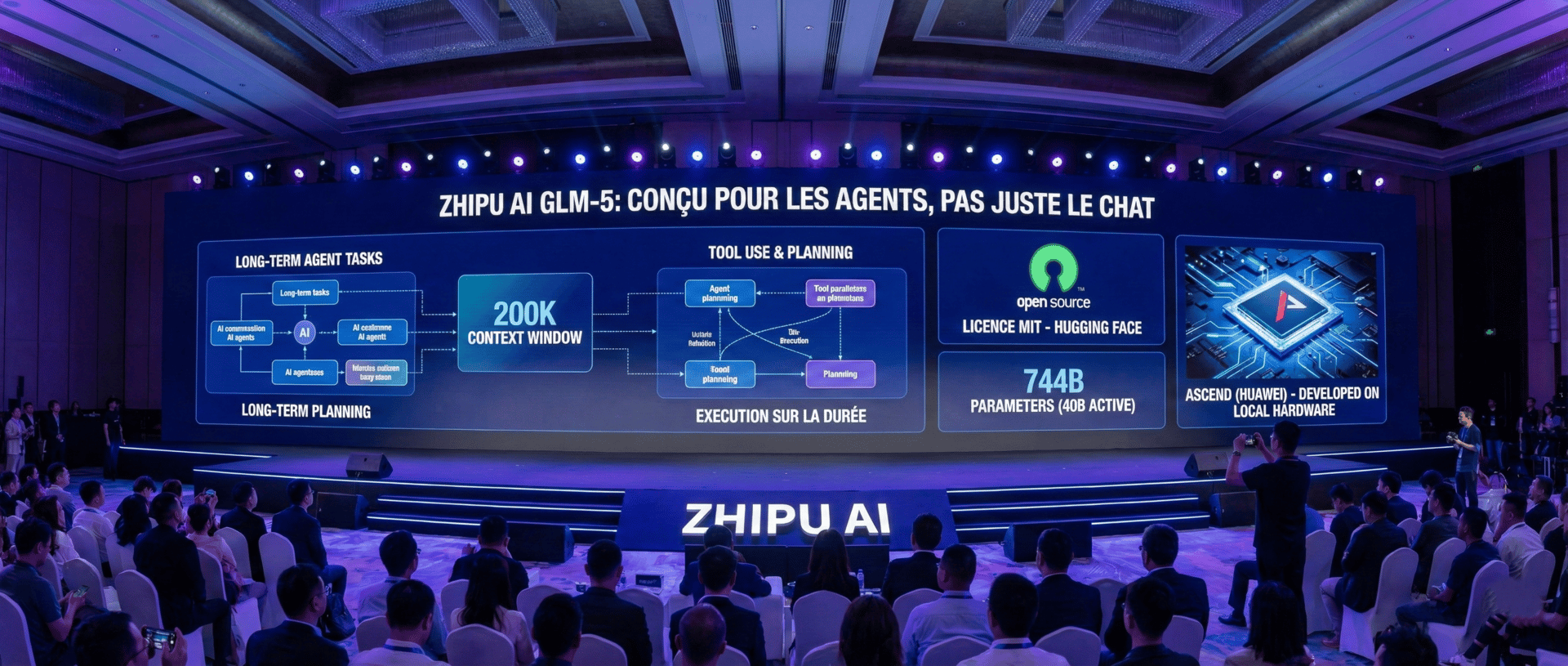

Zhipu AI lance GLM-5 — et ce modèle est clairement « conçu pour les agents », pas juste pour le chat

Si vous suivez la montée en puissance des modèles open source et que vous attendiez le moment où l'un d'eux serait assez bon pour vraiment travailler avec, GLM-5 marque un tournant. Zhipu le présente comme un modèle fondation haut de gamme pensé pour les tâches d'agents à long terme et le vrai travail logiciel — pas seulement la conversation. La documentation développeur annonce une fenêtre de contexte de 200K tokens, et le projet mise à fond sur l'utilisation d'outils, la planification et l'exécution sur la durée.

Ce qui retient mon attention, c'est l'angle open source. La fiche du modèle sur Hugging Face indique une licence MIT, et elle décrit un bond d'échelle considérable par rapport à GLM-4.5 (744 milliards de paramètres au total, dont environ 40 milliards actifs, plus un volume d'entraînement nettement supérieur), accompagné d'une approche d'attention « sparse » conçue pour rendre les longs contextes moins coûteux à faire tourner.

En prenant du recul, c'est aussi un chapitre de plus dans l'histoire « la Chine développe des modèles de pointe malgré des contraintes matérielles ». GLM-5 a été développé en utilisant des puces fabriquées localement pour l'inférence (notamment les Ascend de Huawei), les entreprises chinoises s'adaptant aux restrictions d'exportation de plus en plus strictes.

Elon Musk a annoncé avoir réorganisé l'entreprise « il y a quelques jours » pour accélérer la cadence d'exécution, précisant que cela avait « malheureusement nécessité » de se séparer de certaines personnes. Cette restructuration intervient après le départ de plusieurs cofondateurs — un détail loin d'être anodin quand on veut projeter une image de stabilité avant le prochain grand saut.

La réorganisation fait aussi suite à la récente fusion avec SpaceX, et l'entreprise est désormais divisée en quatre pôles d'activité, avec l'ambition affichée de rivaliser sur les LLM, la génération d'images/vidéos et les outils de code.

L'impression que ça donne : il ne s'agit plus de « fabriquer un meilleur chatbot », mais de « construire toute l'usine ».

ByteDance est en train de développer une puce d'inférence IA et négocie avec Samsung pour la fabrication. L'objectif annoncé : des prototypes d'ici fin mars, au moins 100 000 unités produites cette année, avec une montée en puissance possible jusqu'à 350 000 à terme.

Deux détails supplémentaires qui méritent qu'on s'y arrête :

Les négociations incluraient un accès à des stocks de puces mémoire de plus en plus rares — un goulet d'étranglement dont on ne parle pas assez, mais qui commence à peser sérieusement.

Le budget total consacré à l'IA pourrait dépasser 160 milliards de yuans (environ 22 milliards $) cette année, dont plus de la moitié serait destinée à l'achat de puces Nvidia (dont les H200) en parallèle du développement de la puce maison.

À noter : ByteDance a contesté l'exactitude du rapport dans un communiqué, tandis que Samsung a refusé de commenter.

🧠 RECHERCHE

Entraîner une IA, c'est un peu comme lui faire lire une bibliothèque entière — mais tous les livres ne se valent pas. OPUS est un nouveau système qui choisit intelligemment les données les plus utiles pendant que l'IA apprend. Au lieu de suivre des règles fixes décidées à l'avance, il observe comment le modèle progresse pour lui servir les informations les plus pertinentes au bon moment. Résultat : des modèles plus puissants, entraînés plus vite, pour un coût supplémentaire minimal.

Et si, au lieu de deviner ce qui va apparaître sur un écran pixel par pixel, l'IA écrivait le code qui produit cet écran ? C'est l'idée de Code2World : le système prédit ce qui se passe ensuite dans une application en générant du code HTML. En s'entraînant sur des milliers d'exemples de smartphones, il permet aux assistants numériques de comprendre bien mieux les interfaces — et de naviguer dans les menus et les boutons avec une précision nettement supérieure aux approches précédentes.

Ant Group a développé UI-Venus-1.5, une IA capable de piloter smartphones et ordinateurs exactement comme le ferait un utilisateur humain. Elle excelle dans la reconnaissance d'icônes et la navigation dans des applications complexes, notamment les apps chinoises les plus populaires. Grâce à une combinaison de techniques d'apprentissage avancées, elle surpasse les systèmes existants pour accomplir des tâches concrètes comme faire du shopping en ligne ou modifier des paramètres.

📲 RÉSEAUX SOCIAUX

🗞️PLUS D'ACTUALITÉS

Mistral investit massivement en Suède Mistral construit un data center de 1,2 milliard $ en Suède pour faire tourner son IA avec de l'énergie verte et bon marché. Ce projet colossal vise à réduire la dépendance de l'Europe vis-à-vis de la technologie américaine. Une étape majeure pour l'entreprise française dans sa tentative de rivaliser avec les géants américains.

Chamboulement chez OpenAI OpenAI a dissout l'équipe chargée de s'assurer que sa technologie reste alignée avec les valeurs humaines. Le responsable de l'équipe sera muté vers un nouveau rôle de « futuriste », tandis que les autres membres sont réaffectés. Ce changement suggère que l'entreprise continue de privilégier la vitesse de mise sur le marché au détriment de la sécurité.

Blackstone mise gros sur Anthropic Blackstone augmente son investissement dans Anthropic, valorisant la startup IA à 350 milliards $. Le fonds ajoute 200 millions $ à sa participation, portant son investissement total à environ 1 milliard $. Ce deal confirme que les investisseurs voient encore un potentiel énorme dans les concurrents d'OpenAI.

Le rapport « Sabotage » d'Anthropic Anthropic a testé si son dernier modèle IA pourrait « s'échapper » et survivre seul dans le monde réel. Conclusion du rapport : l'IA échouerait probablement à gagner assez d'argent pour payer ses propres coûts de serveur. Ce test aide les ingénieurs à mieux comprendre les risques qu'une IA tente de manipuler les systèmes humains.

Les dangers de la pub dans ChatGPT Une ancienne chercheuse d'OpenAI alerte : intégrer de la publicité dans ChatGPT brise la confiance entre l'utilisateur et l'IA. Elle argue que cette décision force l'entreprise à prioriser les annonceurs plutôt que les personnes qui posent des questions au chatbot. Le risque : transformer l'outil en machine à collecter des données, à la manière des réseaux sociaux.

Le méga data center de Meta Meta lance la construction d'un data center de 10 milliards $ dans l'Indiana, conçu spécifiquement pour l'IA. L'installation sera l'une des plus grandes au monde et fonctionnera entièrement à l'énergie renouvelable. Un rappel de l'infrastructure physique colossale nécessaire pour faire tourner la prochaine génération d'intelligence artificielle.

Le « Deep Think » de Google Google a dévoilé un nouveau système IA qui « réfléchit » étape par étape face à des problèmes complexes de mathématiques et de sciences. L'outil est capable de vérifier ses propres réponses et aide déjà des chercheurs à résoudre des défis de niveau doctorat. Il est conçu pour être un partenaire fiable pour les scientifiques, et non un simple chatbot.